2020年是5G大规模商用之年,随着其影响范围的不断扩大,5G将汇聚更多的智能业务和智慧场景。在这样的背景下,以4K/8K、VR/AR、IoT等为代表的业务将迎来新的局面,而这些业务也将进一步赋能大屏视听,并衍生出新的价值。对产业而言,当下的重点是如何将这些与5G关联的新兴业务和应用场景尽快实现落地,并找到良性的商业模式。

基于此,2020年10月20-21日,由流媒体网主办的第二十届浦江论道暨中国IPTV/OTT智能视听产业高峰论坛上,特设立以“5G·创智”分论坛,集中探讨5G下的视听产业进化路径。

在该论坛上,广州我趣网络科技有限公司 CTO/总导演3DVR防眩晕视频制作技术创始人朴君做了主题为《解决3D VR防眩晕技术,首创交互式视频》的演讲。

以下为演讲全文:

参加浦江论道5G论坛,稍微有点紧张,作为该论坛的最后一位发言人,我今天要讲的是3DVR视频的发展需要经过三个阶段,初期追求的是数量,中期追求的是质量,现在追求的是优质视频的增量。从数量、质量到增量,可以看出国内的VR视频的算法已经突破了关键性的一些难题。

核心竞争力:3DVR技术

目前国内的一些优质VR视频体验感已经远远超过了美国、欧洲。3DVR很多影视圈的朋友和我说,VR视频的制作不就是一个前端的事儿吗?目前视频的门槛很低,但要制作消费级的优质的视频不是那么容易的,因为传统视频的一些语言包括推拉和升降已经不再是VR视频拍摄的。

无人机拍摄的视频,无论是大屏还是小屏,看起来就很大气,但VR就一定要慎重,因为用户带上头衔,不仅仅是观看者,也成了虚拟场景的要素或是VR影视剧中的一个角色,所以跟现实是一样的。现实生活当中,人不是鸟类,没有翅膀,这跟人的认知行为产生了冲突,所以要反过来研究人在现实当中认知的行为。

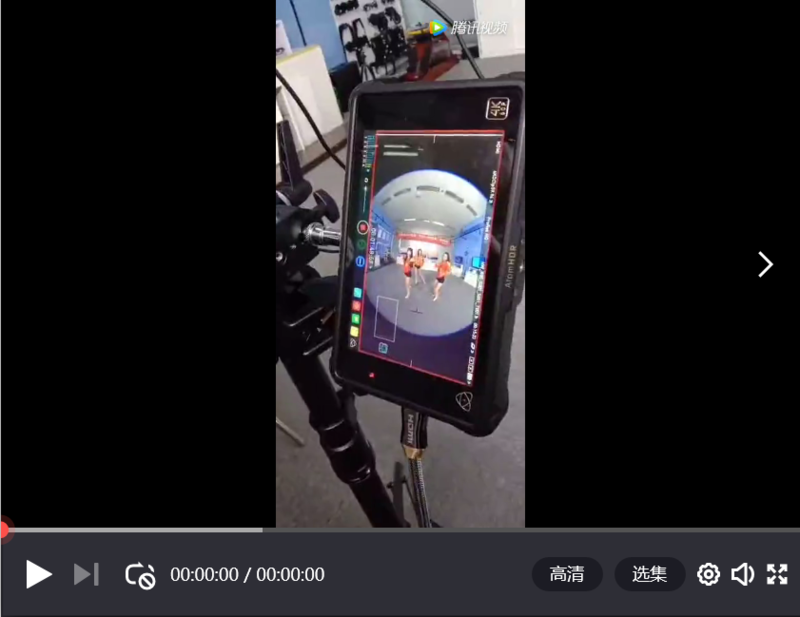

点击图片观看视频

从开发到现在,我们一直坚持VR视频一定要3D,为什么一定要有3D呢?因为人在现实生活中感知到的世界本身就是由三维一体构成的世界,VR也是一样的,它不像大屏小屏是垂直的,它是球形的。例如,现实生活中有个人走近,走得再近会变成一个巨人吗?不可能的。所以,一定会有认知,而我们跟现实中的认知产生了冲突,大脑会极度的不舒服,一定要一比一还原真实的场景。

VR视频的拍摄是不是复杂?其实很简单,跟传统视频的制作是一样的,前期拍摄后期制作。为了防眩晕,前期拿了很多的制作费用,拍出来的东西晕是不可以的,所以我们都会用一些电脑模拟形式去测一测它的眩晕感程度,就可以知道眩晕的程度要达到哪个级别,真正实拍之后的视频是不晕的。

点击图片观看视频

下面是我们前期建膜的,这些建膜的视频一定会晕,但上面实拍是不晕的,因为我们始终坚持3D实拍。3D实拍需要什么呢?首先需要一个拍摄架,我们自己开发了一个拍摄架,只要把摄影机固定在拍摄架上,就不需要再去拍摄,包括现场直接上三角架。

刚开始的时候,VR视频拍摄经常拿着廉价的一体机在市面上这样拍拍那样拍拍的。这个过程求的是数量,但拍摄视频的质量过于低下,人基于好奇就尝试了这样的视频,几十秒就开始眩晕,之后就不再尝试。因为经历了这个阶段,现在我们定的目标一定要去多制作优质的视频,因为低级的视频会严重影响到用户后续的一些消费信心。

点击图片观看视频

这个是我们VR视频拍摄出的视频素材的效果,需要经过后期的反击链,因为摄影机拍摄的时候即使有再好的三角架,但拍摄之后,两台摄影机的调整绝不是100%统一的,所以后期一定要重新做调整。如果是3D视频水平不一致,就会出现这种现象。请点击上述视频,人脸是不是出现了眩晕?这个视频是我们做的一个测试,左侧跟右侧的视频,它比左侧高,会出现重影。看到这种视频一定会晕,人在现实生活当中看到一个人的脸不会出现这样的感觉,所以后期一定要去精修前期拍摄的不足。

点击图片观看视频

这两张图片的视频后期,我们为了视频的沉浸感,所以通过后期的一些处理把后边的一些灯光处理掉,一个是调色,一个是最终的输出。

基于VR特性,我们开放了交互视频。拍摄视频的时候,会按男女主,主观的视觉拍完一个大全景,然后会按主观的视觉重新拍一遍视频,在输出之后会设计两个通道:一个是女主通道,一个是男主通道,用户根据自己的性别选择各自的通道。但VR投显看这样的视频,就会觉得自己成了这个故事里面的主人公,可以更加体验对方的这种情感。

未来已来—创造未来“矩阵”革命

点击图片观看视频

通过3DVR的防眩晕技术赋能的一些产品,有演绎类的、影视类的、健身类等。上面的这个视频现在在华为视频还有爱看可以观看。这是一个3DVR直播的系统,包括北京的VR,最终成播是4K版,4K 3840的直播。

简单说一下,我可以清楚看到第一排人所有的脸,第二排第三排可以看到基本的结构,但细节性的东西是看不见的,由于长期习惯了2D的变化,从全景到特写,每一个景都可以看得很清楚。从用户的观看习惯中可以发现,4K的直播是有局限性的,它适用于一个小场景,例如一些像网红的直播是OK的,但作为一个赛事直播来说,它还是则具有局限,因为2016年、2017年也经历过这样的事情。

体验感没有达到预期,真的会严重影响后续的消费,这是我们在华为的ILab实验室做的直播的测试,去年华为想在推出plus之前,用我们的直播系统做了简单的测试,就是所谓的虚拟影像2.0的版本。开发的时候觉得这个未来很远,但这是一个可以看得见的未来。

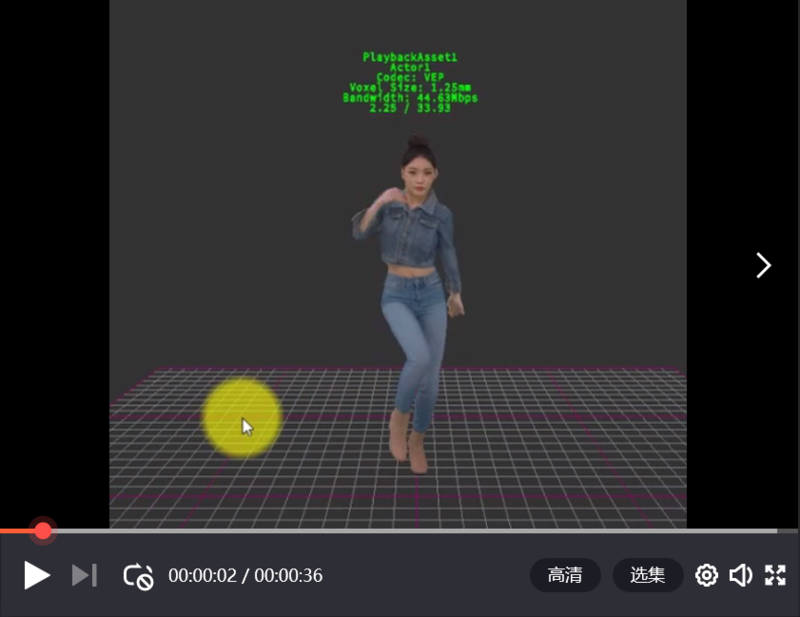

点击图片观看视频

基于矩阵的一个应用场景,我们拍的这个视频只用到了30个点,现在最多能用到80个点,但市面上很多这种矩阵的影像它是以动画人物出现的。因为最后渲染出来书中的视频不是缺个腿就是缺个胳膊,然后环绕后背的皮肤少一块,所以没有办法,只能经过后续的处理,动画的形式输出。

点击图片观看视频

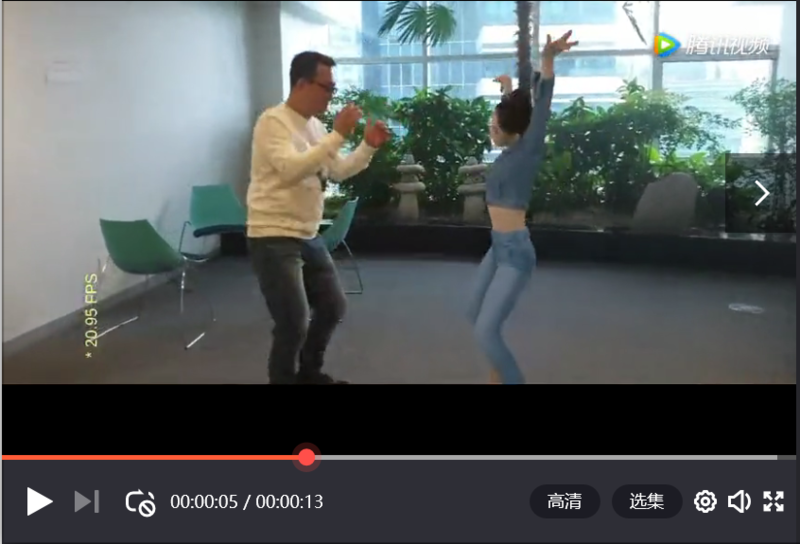

这是一个手机VR的应用,但如果微软再便宜一点,功能再强大一些,我们戴上VR眼镜,永远都是虚拟的形象,只有我一个人可以看得见,可以跟他近距离在我的房间里进行互动。但目前还没有这个条件,只能用在AR的应用上,所以这个市场并不大。

点击图片观看视频

最后,就是5G+MR+AI交互式应用,看过科大讯飞今年在世界VR大会上的一个报告,它们做的虚拟主持人以及人工智能已经非常好了,其应用场景如视频所示。目前,微信只能是文字、语音和视频,当到了VR的应用就会这样,因为云计算的发展还需要后续技术的支撑,未来不能说所有人,但大部分人都可以在云端拥有自己的虚拟影像,且人跟人之间的信息的传输方式和模式会发生根本性的变化。

以上是演讲的全部内容,谢谢!

责任编辑:侯亚丽

24小时热文

流 • 视界

专栏文章更多

- [探显家] 好莱坞的“浮士德交易”:Paramount 和 Netflix 的竞购之战 2025-12-16

- [常话短说] 【解局】某广电向不良资产动刀 2025-12-16

- [常话短说] 【热评】广电做“错”了什么?! 2025-12-15

- [常话短说] 【重要】广电“壮士断腕”! 2025-12-11

- [常话短说] 【解局】广电降本增效“大有空间”?! 2025-12-10