Character.AI 推出 AvatarFX 模型:AI 实现静转动,让图片角色开口说话

故渊|

IT之家| 2025-04-23

【流媒体网】摘要:Character.AI推出AvatarFX模型,采用先进SOTA DiT-based技术实现高保真效果。

Character.AI公司在 X 平台发布推文,宣布推出 AvatarFX 模型,能够让静态图片中的人物“开口说话”。

用户只需上传一张图片并挑选一个声音,平台即可生成会说话、会移动的形象。这些形象还能展现情感,呈现出令人惊叹的真实感和流畅度。

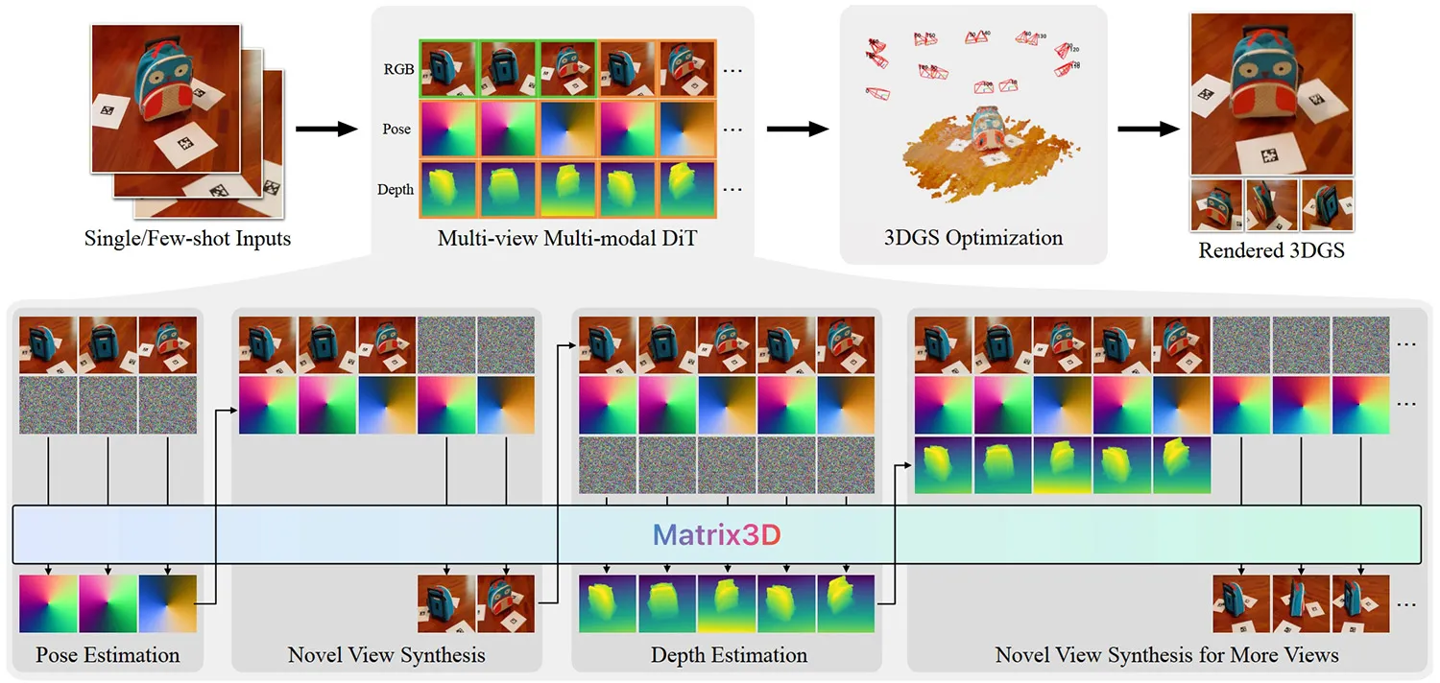

公司表示,这得益于一种名为“SOTA DiT-based diffusion video generation model”的先进 AI 模型。该模型经过精心训练,结合音频条件优化技术,能高效生成高质量视频。

AvatarFX 的技术亮点在于其“高保真、时间一致性”的视频生成能力。即便面对多角色、长序列或多轮对话的复杂场景,它也能保持惊人的速度和稳定性。与 OpenAI 的 Sora 和 Google 的 Veo 等竞争对手相比,AvatarFX 并非从零开始或基于文本生成视频,而是专注于将特定图片动画化。

这种独特的工作流程为用户提供了新颖体验,但也带来了潜在风险。用户可能上传名人或熟人照片,制作看似真实的虚假视频,引发隐私争议。

责任编辑:凌美

版权声明:凡注明来源“流媒体网”的文章,版权均属流媒体网所有,转载需注明出处。非本站出处的文章为转载,观点供业内参考,不代表本站观点。文中图片均来源于网络收集整理,仅供学习交流,版权归原作者所有。如涉及侵权,请及时联系我们删除!

今日聚焦更多

24小时热文

流 • 视界

专栏文章更多

- OTT月报|2025年4月智能电视大数据报告 2025-05-27

- IPTV月报|2025年4月家庭智慧屏IPTV报告 2025-05-27

- 见微知著|对话爆款制造机听花岛,短剧的“短”究竟是什么? 2025-05-19

- [常话短说] 【重要】5G能否救广电?! 2025-05-13

- IPTV月报|2025年3月家庭智慧屏IPTV报告 2025-05-08